Vous avez récemment intégré des outils d’IA dans votre agence d’emploi pour gagner en efficacité ? C’est un choix judicieux, car ces solutions améliorent significativement les processus et offrent des gains importants.

Mais comment concilier cette innovation avec une sécurité juridique optimale et garantir que vos décisions assistées par l’IA restent conformes à la loi ? Comment protéger votre responsabilité tout en tirant parti des avantages de cette révolution technologique ? Laissez-nous vous guider.

L’IA comme levier de performance dans l’intérim

Gain de temps, aide à la prise de décision, personnalisation de l’expérience intérimaire… Autant de bénéfices à utiliser l’IA. Voici quelques exemples concrets où elle peut vraiment faire la différence.

Le recrutement et le matching candidats/missions

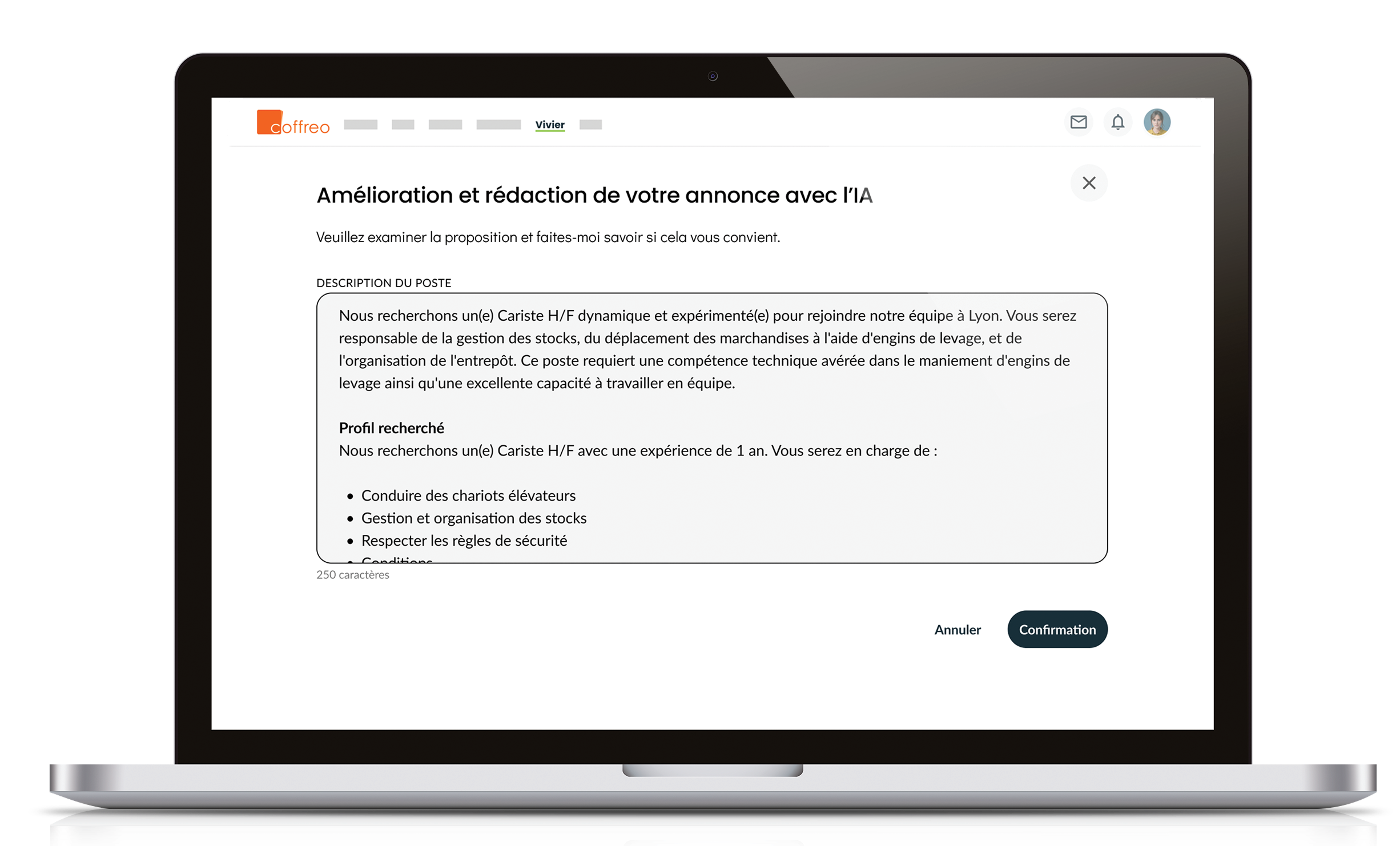

L’IA simplifie énormément la rédaction des annonces. Par exemple, grâce à des algorithmes puissants, une fonctionnalité de notre nouvelle solution Coffreo Staffing vous aide dans la rédaction de vos offres pour les rendre plus attractives.

Dans l’étape de tri des CV, l’IA vous assiste dans l’identification des qualifications des candidats grâce à une analyse rapide de centaines de profils. Vous pouvez alors choisir les meilleurs intérimaires pour une commande. C’est un gain de temps précieux, à retrouver également dans Coffreo Staffing.

L’amélioration de l’expérience intérimaire

Autres technologies : les chatbots et systèmes automatisés sont désormais capables de maintenir un contact régulier avec les candidats intérimaires, améliorant leur expérience et réduisant le taux d’abandon pendant le processus de recrutement.

Par exemple, le groupe L’Oréal utilise un chatbot alimenté par l’IA pour interagir avec les candidats pendant le processus de recrutement. Le chatbot peut répondre aux questions, collecter des informations, programmer des entretiens et fournir des mises à jour sur le statut des candidatures. Une solution qui peut se déployer en agence d’emploi.

Dans le futur, l’IA pourra même automatiser la collecte des préférences et disponibilités des candidats pour améliorer la performance du matching avec les missions disponibles.

Bon à savoir : 33% des intérimaires déclarent que les agences ne tiennent pas compte de l’évolution de leur situation personnelle pour leur proposer des missions adaptées (Baromètre Coffreo, 2024).

L’automatisation des missions administratives

À l’avenir, les IA pourront aussi automatiser la saisie des contrats et détecter les incohérences dans les relevés d’heures par exemple. Pour vos équipes, ce sera un gain de temps qui leur permettra de se concentrer sur des tâches plus stratégiques, comme la gestion de la relation client.

L’analyse prédictive

Enfin, grâce à l’analyse des tendances du marché et des historiques de missions, Emmanuel Cudry, fondateur de Coffreo, confirme dans une interview que certains systèmes d’IA seront capables de prédire les besoins futurs en recrutement de vos clients, vous permettant d’anticiper les demandes et de préparer un vivier de candidats intérimaires avant même qu’une mission soit ouverte.

Ces bénéfices sont indéniablement attrayants, mais il est essentiel de prendre en compte les risques juridiques que l’IA peut présenter. Voici les défis majeurs que vous devez connaître avant de déployer vos outils.

Les défis juridiques et éthiques de l’IA dans l’intérim

La responsabilité en cas de discrimination algorithmique

Selon Amélie Raoul, chercheuse et doctorante en IA qui accompagne les entreprises et institutions dans l’adoption d’une IA éthique, le recrutement est l’un des domaines les plus à risque de biais algorithmiques : « beaucoup d’ATS excluent des profils compétents simplement en raison de la formulation des compétences ou l’absence de mots-clés ».

L’IA peut également exclure des candidats sur des critères non pertinents comme l’âge, le sexe ou l’origine, entraînant des discriminations à l’embauche. Comment expliquer cela ? Pour notre chercheuse, la raison est simple : « ces biais existent parce que les bases de données elles-mêmes sont souvent biaisées. »

Ces risques peuvent avoir des répercussions financières et d’image particulièrement lourdes. Et pour cause. Rappelons qu’en présence d’une discrimination, l’agence d’emploi engage sa responsabilité civile et pénale. En se fondant sur l’article L.1132-1 et suivants du Code du travail, un candidat peut engager des poursuites devant le Tribunal judiciaire pour demander des dommages et intérêts pour le préjudice subi, voire la nullité de la décision. Sur le plan pénal, le responsable risque jusqu’à 3 ans d’emprisonnement et 45 000€ d’amende.

La responsabilité de l’agence d’emploi : une vigilance accrue avec l’IA

Un système automatisé qui affecte un intérimaire à une mission alors qu’il n’a pas les compétences requises peut entraîner des retards ou une mauvaise qualité de service pour l’entreprise cliente.

Dans une telle situation, c’est à vous en tant qu’agence de répondre de cette erreur, car vous êtes responsable de l’adéquation entre les profils et les missions conformément au contrat qui vous lie avec vos clients. C’est pourquoi il est crucial de maintenir une vigilance constante sur les décisions prises par l’IA.

Comme l’indique Emmanuel Cudry dans son interview sur les bénéfices de l’IA, cette nécessité va amener les consultants à développer de nouvelles compétences pour piloter les outils d’IA.

« Leur rôle sera davantage celui de superviseur et de contrôleur, que celui d’exécutant. »

Emmanuel Cudry, Fondateur de Coffreo

L’impact de l’AI Act

L’AI Act renforce les exigences de transparence et de gestion des biais dans les systèmes d’IA. À titre d’exemple, ce règlement encadre les systèmes d’IA destinés à être utilisés pour le recrutement ou la sélection de personnes physiques, notamment pour publier des offres d’emploi ciblées, pour analyser et filtrer les candidatures et pour évaluer les candidats.

Son entrée en vigueur étant prévue le 2 août 2026, vous devrez probablement ajuster vos pratiques et garantir que chaque décision prise par vos outils est tracée et auditable. Il est alors essentiel de tester régulièrement vos outils pour éviter toute discrimination et garantir que les décisions prises par l’IA peuvent être justifiées.

Notez que si vous ne respectez pas ces obligations, la sanction administrative peut là aussi être (très) lourde : jusqu’à 30 millions d’euros ou 6% du chiffre d’affaires mondial en cas de non-conformité.

Heureusement, il existe des actions que vous pouvez mettre en place pour éviter ces risques et utiliser l’IA de manière responsable et conforme.

5 solutions concrètes pour une IA responsable et conforme en agence d’intérim

1/ L’audit préalable de vos outils d’IA : sécuriser sa chaîne technologique en amont

Pour Amélie Raoul, si l’IA est utilisée de manière éthique, les inégalités d’accès à l’emploi temporaire vont se réduire. Et pour cela, elle précise qu’ « avant de déployer des outils d’IA, il est crucial d’auditer leur conformité et leur éthique pour détecter les variables corrélées à des critères discriminants ».

Pour ce faire, posez à vos fournisseurs les bonnes questions :

- Comment vos outils évitent-ils la discrimination ?

- Quelles données sont utilisées pour former l’algorithme ?

- Comment l’IA fait-elle ses recommandations ?

De même, n’hésitez pas à exiger des garanties de conformité en déployant une ou plusieurs actions :

- Faire auditer les outils par un organisme indépendant en éthique et conformité ;

- Demander des certifications de conformité aux normes européennes ;

- Obtenir des rapports détaillant les mesures contre les biais ;

- Intégrer des clauses sur la transparence et la gestion des biais dans vos contrats ;

- Tester la solution dans des conditions réelles avant de l’adopter à grande échelle.

2/ Le principe de supervision humaine : préserver le contrôle sur les décisions clés

N’est-ce pas tentant de se laisser porter par l’algorithme lorsque ses recommandations ont déjà montré leur efficacité ? Probablement. Mais attention : même si l’IA fait des recommandations pertinentes, un responsable doit toujours intervenir pour s’assurer que les décisions automatisées sont justifiées.

Prenons un exemple concret : imaginez que l’algorithme écarte un bon candidat simplement parce qu’il n’a pas utilisé les bons mots-clés dans son CV, ou qu’il ne correspond pas à un modèle précis que l’algorithme juge pertinent. Ce genre de décision peut sembler logique pour la machine, mais elle ne capte pas les nuances humaines, comme l’adaptabilité ou le potentiel du candidat. C’est là qu’un responsable doit intervenir pour s’assurer que le rejet est réellement justifié.

3/ Formation et gouvernance interne : créer une culture de vigilance

Comment fonctionnent les outils d’IA ? Comment intervenir si je détecte un dysfonctionnement ou un biais algorithmique ? Prendre en main des systèmes d’IA est loin d’être évident pour vos équipes. Et encore moins lorsqu’il s’agit de les utiliser de manière responsable et conforme. Dès lors et conformément à l’article 4 de l’AI Act, il est important de former vos consultants sur le fonctionnement de l’IA, ses risques et les bonnes pratiques à suivre pour éviter les erreurs.

4/ Communication transparente avec les parties prenantes

La transparence est essentielle pour maintenir la confiance de vos intérimaires et clients dans l’utilisation de l’IA. Pour la garantir et vous protéger sur le plan juridique, pensez à documenter chaque décision prise par l’algorithme.

Pour ce faire, Amélie Raoul préconise la “journalisation”, un système qui enregistre dans des “fichiers journaux” ou “logs” des activités métier des utilisateurs, des interventions techniques, des anomalies et des évènements liés à la sécurité. Concrètement, ces systèmes visent à tracer toutes les décisions algorithmiques de façon à assurer la sécurité des traitements (pourquoi une candidature a-t-elle été rejetée ? À partir de quels éléments ?).

Non seulement cela vous protège juridiquement, mais vous aide aussi à maintenir la confiance des candidats et des partenaires. D’ailleurs, “certains systèmes utilisent même des IA pour générer des explications (ex: on refuse un candidat à un poste, l’outil explique que c’est parce qu’il n’a pas renseigné sa disponibilité)”, ajoute notre chercheuse.

Pour aller dans ce sens, informez clairement vos intérimaires et entreprises clientes sur la manière dont l’IA est utilisée dans le processus de recrutement et de gestion des missions. Par exemple, si un candidat est exclu par l’IA, expliquez-lui les critères qui ont conduit à cette décision : compétences, expérience, correspondance avec les mots-clés, etc.

Cette démarche permet non seulement de répondre aux préoccupations du candidat intérimaire, mais aussi de montrer que l’IA n’est qu’un outil d’aide à la décision, et non un processus inflexible.

5/ Anticipation des évolutions réglementaires : rester conforme dans la durée

L’IA est un domaine en constante évolution, tout comme les régulations qui l’entourent. Ainsi, en cas de nouvelles obligations en matière de transparence des décisions automatisées, vous devrez être prêt à revoir vos méthodes de documentation ou à modifier votre communication avec les intérimaires. Pour ce faire, pensez à suivre les mises à jour légales de près et à ajuster vos processus en conséquence.

Par où commencer ? Les étapes concrètes pour une transition vers l’IA sécurisée

- Évaluez vos besoins : Identifiez les processus où l’IA peut apporter un gain d’efficacité, comme le recrutement et l’automatisation des tâches administratives.

- Réalisez un audit éthique et juridique : Faites auditer vos outils d’IA pour identifier et minimiser les risques de biais et assurer leur conformité avec le RGPD et l’AI Act.

- Formez vos équipes : Assurez-vous que vos consultants sont formés aux risques associés à l’IA et aux bonnes pratiques pour la superviser de manière éthique et responsable.

- Déployez progressivement : Lancez un projet pilote dans un domaine spécifique avec une supervision humaine des décisions prises par l’IA, et ajustez les processus selon les retours.

- Suivez et ajustez régulièrement : Maintenez une surveillance continue de vos outils et ajustez-les en fonction des évolutions légales et des résultats obtenus.

En résumé, l’IA peut grandement améliorer l’efficacité de votre agence d’emploi, mais elle comporte également des risques juridiques importants. En mettant en place des audits, une supervision humaine, et une gestion rigoureuse de la transparence, vous pouvez en maximiser les bénéfices tout en minimisant les risques.